1. CUDA Core、Tensor Core与RT Core

1.1. CUDA Core

CUDA Core 是 NVIDIA GPU 中最基础、最通用的并行处理单元。它的全称是 “Compute Unified Device Architecture Core”。你可以把它想象成 GPU 中的“通用工人”,负责处理各种类型的计算任务。

英伟达 GPU 的参数中,最常看到的核心类型。 Nvidia 通常用最小的运算单元表示自己的运算能力, CUDA Core 指的是一个执行基础运算的处理元件。我们所说的 CUDA Core 数量,通常对应的是FP32计算单元的数量。

1.2. Tensor Core

Tensor Core 是一种专门为执行矩阵乘法和累加(MMA) 操作而设计的专用硬件单元。它从 Volta 架构(V100)开始引入,并在后续架构中不断增强。矩阵运算是人工智能(AI)和深度学习训练的基石。

核心特别大,用于机器学习加速,它可以把整个矩阵都载入寄存器中批量运算,实现十几倍的效率提升,从 Volta 架构发布以来,奠定了英伟达在 AI 训练的领军地位,每次升级都有新支持的数据类型。

1.3. RT Core

RT Core 是专门为实时光线追踪计算而设计的硬件加速单元。它从 Turing 架构(RTX 20系列)开始引入。光线追踪涉及大量复杂的“光线与三角形求交”测试和边界体积层次(BVH)遍历操作,这些操作在通用核心上计算成本极高。

正常数据中心级的 GPU 核心是没有 RT Core 的,主要是消费级显卡才为光线追踪运算添加了 RT Cores ,考虑到芯片的空间有限,每个 SM 里面只有1个光追核心(为此还砍掉了大部分的FP64)。可以极大地提升了游戏渲染效率。

1.4. 三者之间的关系

| 特性 | CUDA Core | Tensor Core | RT Core |

|---|---|---|---|

| 定位 | 通用计算 | 专用计算(AI/矩阵) | 专用计算(光线追踪) |

| 主要功能 | FP32/INT32 标量运算 | 低精度矩阵乘加运算 | 光线求交与BVH遍历 |

| 精度支持 | FP32, FP64, INT32 | FP16, BF16, TF32, FP8, INT8, INT4, … | 固定功能硬件,不直接暴露精度 |

| 灵活性 | 高,可编程处理各种任务 | 中,专门处理矩阵运算 | 低,硬件固化功能,用于特定任务 |

| 性能目标 | 高吞吐的并行计算 | 极致的AI计算吞吐量 | 实时光线追踪性能 |

| 引入时间 | Tesla(G80) | Volta(V100) | Turing(RTX 20) |

2. 查看GPU的CUDA Core数量

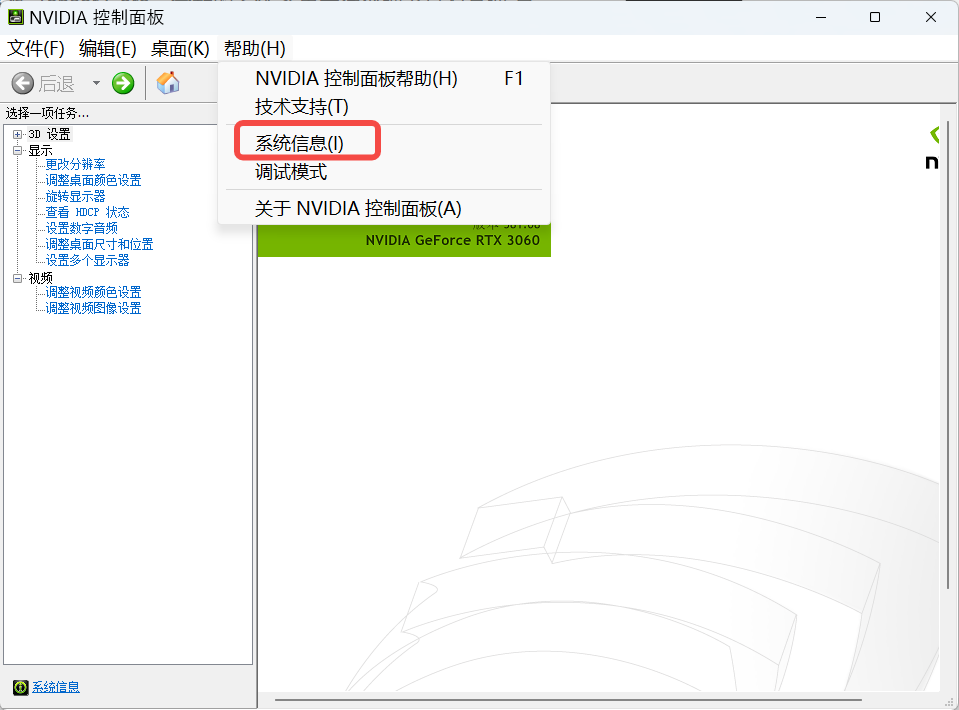

2.1. NVIDIA控制面板

- 打开

NVIDIA控制面板,选择菜单:帮助->系统信息。

- 可以查看对于的型号和CUDA Core的数量,及其他相关的参数。

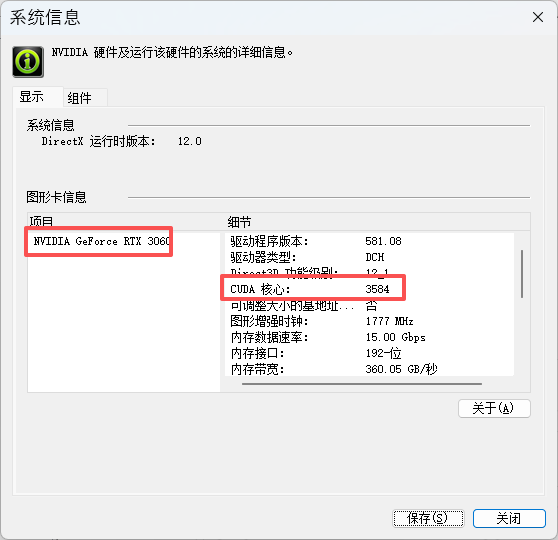

2.2. nvidia-smi命令行

1 | nvidia-smi |

说明:

nvidia-smi不能查看CUDA的核心数,但是可以查看CUDA的版本。- nvidia-smi(

NVIDIA System Management Interface)是一个基于命令行的工具,是 NVIDIA 显卡驱动的一部分。它主要用于监控和管理 NVIDIA GPU(图形处理器)的状态和性能,特别是在数据中心、服务器和工作站环境中。它一般是 NVIDIA 显卡驱动程序的一部分,会在你安装官方 NVIDIA 显卡驱动时自动安装。

2.3. 官方规格文档

- 访问NVIDIA官方网站。

- 在产品页面选择你的显卡型号(如GeForce RTX 30/40系列、Tesla、Quadro等)。

- 查看详细的参数信息。

3. RTX 3060的核心数

| 核心类型 | 核心说明 | 数量 | 代别 |

|---|---|---|---|

| CUDA Core | 通用计算核心 | 3584 | — |

| Tensor Core | 矩阵计算核心 | 112 | 第三代 Tensor Core |

| RT Core | 光线追踪核心 | 28 | 第二代 RT Core |

说明:

CUDA Core数量可以直接查看。Tensor Core和RT Core的数量可以推算出来,推算规则见后文。

Tensor Core数量的计算:

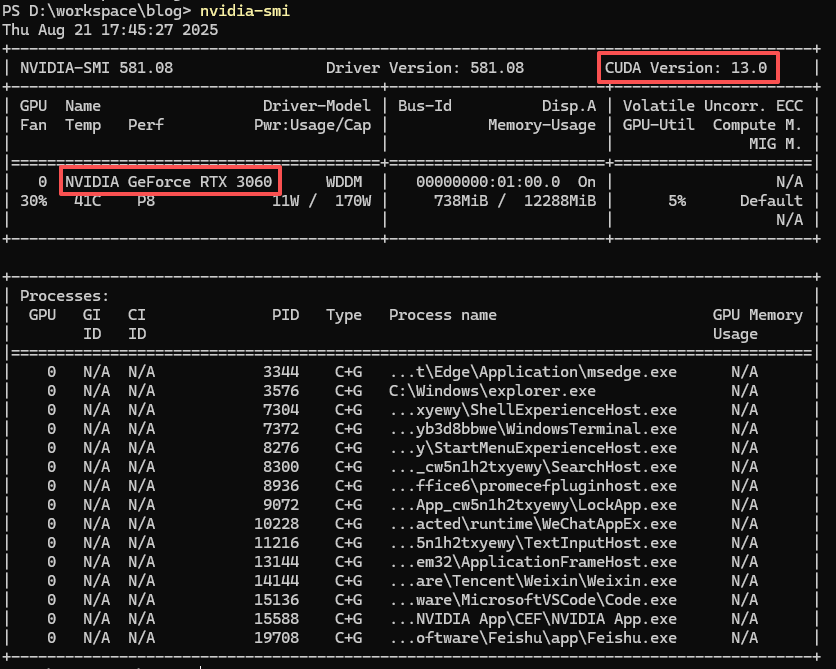

Ampere架构第二代RTX的SM架构图

RTX 3060的GPU架构是Ampere,按照这个参数说明,一个SM包含128(164 FP32 + 164 FP32/INT32)个CUDA Core+ 4个Tensor Core+ 1个RT Core。RTX 3060有3584个CUDA Core,所以有3584/128=28个SM,Tensor Core的数量 = 28*4 = 112,RT Core的数量 = 28。

参考文档: